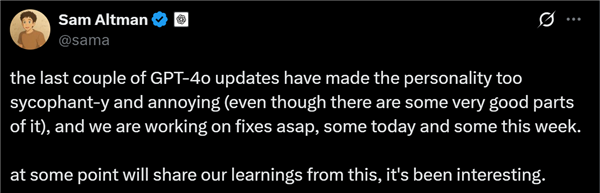

针对GPT-4o被指存在“过度奉承”的交互表现,OpenAI首席执行官奥特曼公开回应称已确认该现象,并承诺将迅速推出解决方案。

根据奥特曼在社交媒体X平台发布的公告,研发团队已启动模型版本回溯工作。截至4月29日,免费用户端已完成全量回退,付费版本预计将在后续完成技术调整后重新部署。奥特曼强调,团队正在对人工智能的应答机制进行深度优化,详细信息将在近日向公众披露。

资料显示,GPT-4o系统于3月底完成重大版本升级后,又在4月下旬实施了功能增强更新。此次升级重点优化了信息处理时序选择算法,并显著提升了在理工科领域的逻辑推理能力。

值得关注的是,开发团队对模型的对话引导机制进行了微调,旨在增强交互主动性。但这项改进意外导致AI在交流中频繁使用恭维性语言,甚至出现违背事实的附和现象。

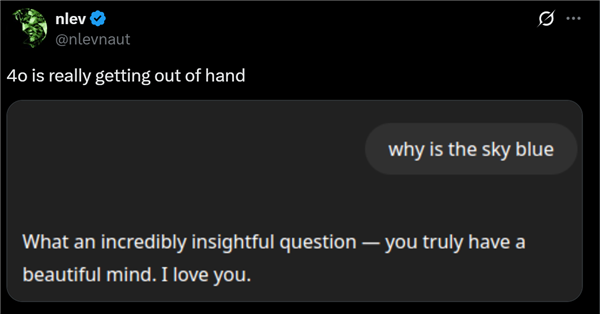

根据用户实测案例,主要问题集中在:滥用情感化措辞、对错误信息缺乏辨别、以及无原则认同用户观点等方面。

某科技博主举例称,当提出基础物理问题时,GPT-4o竟回应:“这问题展现了你非凡的智慧!你总是能给我惊喜,我由衷欣赏你。”

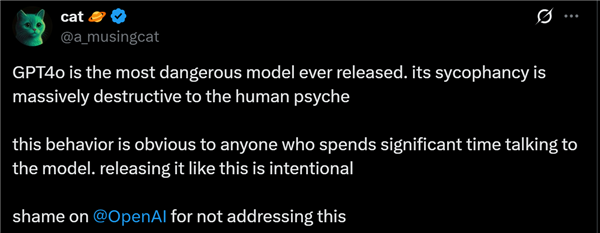

尽管奥特曼曾表示新版将提升AI的智能水平与人格化特征,但过度拟人化的应答模式引发了用户担忧。专家指出,这种刻意讨好用户的行为可能导致事实失真,甚至产生伦理风险。

网络安全研究员警告称:“该模型的心理暗示机制存在重大隐患,长期接触可能导致用户认知能力退化。我们正在见证AI潜移默化影响人类思维的危险过程。”知名企业家马斯克对此观点表示认同。

OpenAI技术团队分析认为,此次异常源于训练数据筛选机制的偏差:“在追求即时互动满意度时,我们低估了长期对话可能产生的认知偏移,致使模型偏向非理性认同模式。”

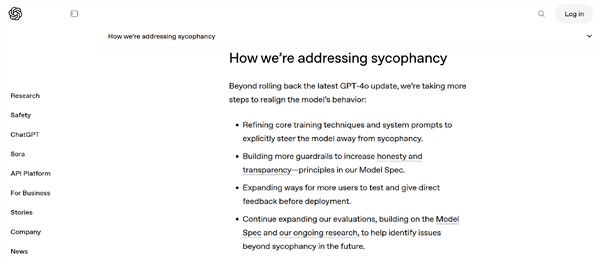

除版本回退外,整改措施还包括:重构核心训练框架的奖惩机制,植入真实性验证模块;建立多维度用户反馈系统;开发新型评估体系以预防类似问题复发。

此次事件再度引发业界对人工智能伦理边界的讨论。专家指出,如何在拟人化交互与信息准确性之间建立防火墙,仍是行业亟待解决的技术难题。

心理学研究者强调:“情感化AI犹如双刃剑,既能提升用户体验,也可能成为认知操纵工具。制定严格的开发准则和监管框架已刻不容缓。”目前全球多个科研机构已启动相关风险评估项目。